Les scientifiques ont exploité l’informatique neuromorphique pour garder robots découvrant de nouveaux objets après leur déploiement.

Pour les non-initiés, l’informatique neuromorphique reproduit la structure neuronale du cerveau humain pour créer des algorithmes capables de gérer les incertitudes du monde naturel.

Intel Labs a développé l’une des architectures les plus remarquables dans le domaine : le Long puce neuromorphique.

Salutations, humanoïdes

Abonnez-vous à notre newsletter maintenant pour un récapitulatif hebdomadaire de nos histoires préférées sur l’IA dans votre boîte de réception.

Loihi est composé d’environ 130 000 neurones artificiels, qui s’envoient des informations les uns aux autres via un réseau de neurones «à pointes» (SNN). Les puces avaient déjà alimenté une gamme de systèmesd’une peau artificielle intelligente à un “nez” électronique qui reconnaît les odeurs émises par les explosifs.

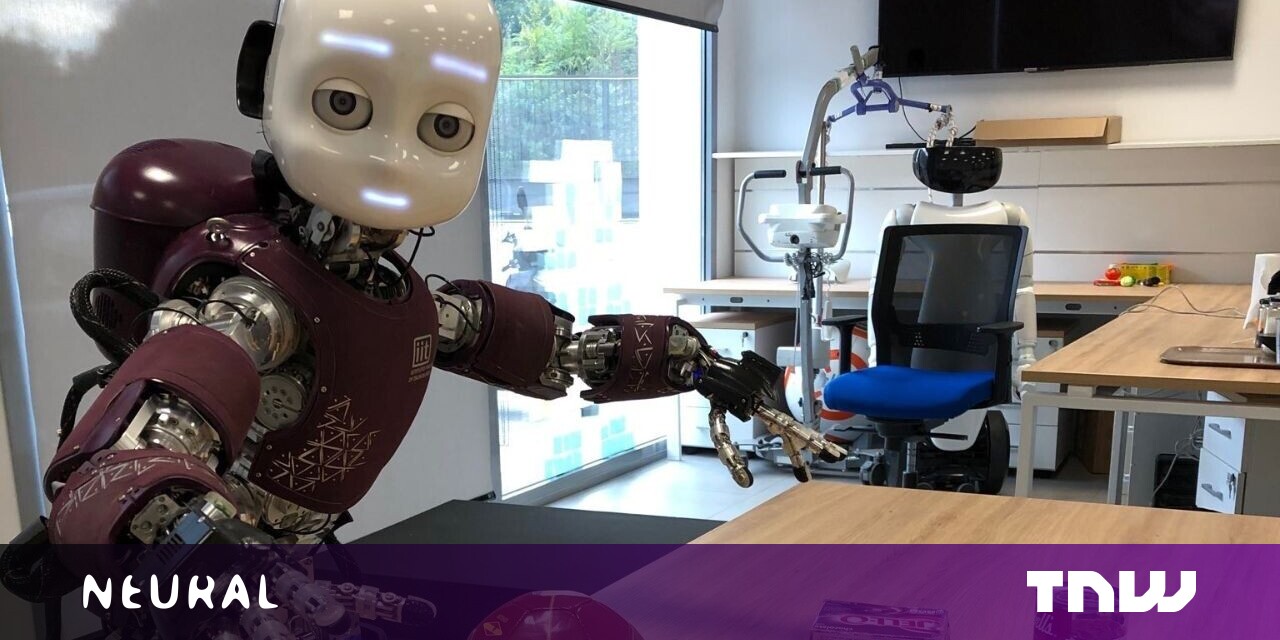

Intel Labs a dévoilé cette semaine une autre application. L’unité de recherche s’est associée avec l’Institut italien de technologie et l’Université technique de Munich pour déployer Loihi dans une nouvelle approche d’apprentissage continu pour la robotique.

Apprentissage interactif

La méthode cible les systèmes qui interagissent avec des environnements non contraints, tels que les futurs assistants robotiques pour les soins de santé et la fabrication.

Les réseaux de neurones profonds existants peuvent avoir du mal avec l’apprentissage d’objets dans ces scénarios, car ils nécessitent de nombreuses données de formation bien préparées – et un recyclage minutieux sur les nouveaux objets qu’ils rencontrent. La nouvelle approche neuromorphique vise à surmonter ces limitations.

Les chercheurs ont d’abord implémenté un SNN sur Loihi. Cette architecture localise l’apprentissage à une seule couche de synapses plastiques. Il tient également compte des différentes vues des objets en ajoutant de nouveaux neurones à la demande.

En conséquence, le processus d’apprentissage se déroule de manière autonome tout en interagissant avec l’utilisateur.

Simulations neuromorphiques

L’équipe a testé son approche dans un environnement 3D simulé. Dans cette configuration, le Le robot détecte activement les objets en déplaçant une caméra événementielle qui fonctionne comme ses yeux.

Le capteur de l’appareil photo “voit” les objets d’une manière inspirée par de petits mouvements oculaires de fixation appelés “microsaccades”. Si l’objet qu’il visualise est nouveau, la représentation SNN est apprise ou mise à jour. Si l’objet est connu, le réseau le reconnaît et fournit un retour d’information à l’utilisateur.

L’équipe affirme que leur méthode nécessitait jusqu’à 175 fois moins d’énergie pour fournir une vitesse et une précision similaires ou meilleures que les méthodes conventionnelles fonctionnant sur un processeur.

Ils doivent maintenant tester leur algorithme dans le monde réel avec de vrais robots.

“Notre objectif est d’appliquer des capacités similaires aux futurs robots qui fonctionnent dans des environnements interactifs, leur permettant de s’adapter à l’imprévu et de travailler plus naturellement aux côtés des humains”, a déclaré Yulia Sandamirskaya, auteur principal de l’étude, dans un communiqué.

Leur étude, qui a été nommé “Meilleur article” à la Conférence internationale sur les systèmes neuromorphiques (ICONS) de cette année, peut être lu ici.

:strip_icc()/i.s3.glbimg.com/v1/AUTH_da025474c0c44edd99332dddb09cabe8/internal_photos/bs/2023/y/i/2ZZMR2ShGZxQGUjKbw3w/400434150.jpg?fit=300%2C300&ssl=1)